La Fabrique à Idiots

Il y a 3 jours, je suis tombé sur une vidéo qui m'a secoué.

Son nom ?

(excellente vidéo de l'excellent Micode — dont j'avale systématiquement les vidéos le jour où elles sortent)

Son postulat ?

L'IA est en train de transformer l'humanité en une fabrique à idiots.

Le noyau dur de l'argument est simple.

L'IA générative crée ce qu'ils appellent une « dette cognitive ».

Késako ?

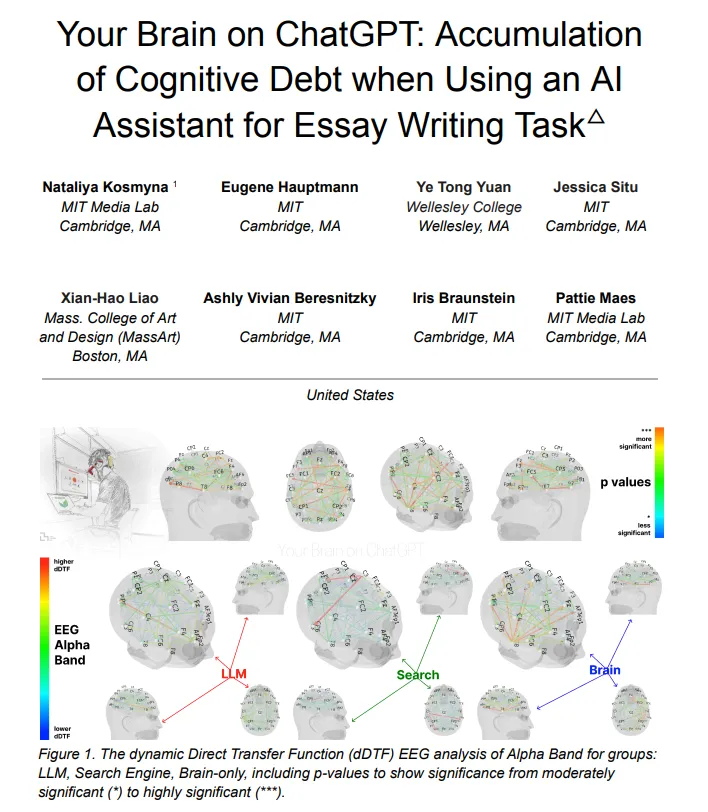

Je pense qu'on a tous déjà vu passer cette étude qui a fracassé internet en juin dernier :

Pour faire court…

Des chercheurs du MIT ont mesuré l'activité cérébrale de gens qui rédigent des textes avec GPT-4 versus ceux qui écrivent sans assistance.

Évidemment, ceux qui utilisent l'IA ont un cerveau... éteint.

Littéralement moins actif.

En « dette cognitive ».

Les exemples s'empilent.

Les développeurs juniors qui codent avec l'IA sans comprendre ce qu'ils produisent…

Les étudiants qui délèguent leurs dissertations et deviennent incapables de structurer une pensée…

Et…

Les seniors qui, eux, utilisent l'IA comme une équipe de juniors à leur service — parce qu'ils maîtrisent déjà les fondamentaux.

La division est nette.

- D'un côté, ceux qui gardent leurs capacités cognitives intactes et amplifient leur impact avec l'IA

- De l'autre, ceux qui s'atrophient sans s'en rendre compte

La vidéo conclut en expliquant que ce n'est pas l'IA qui nous rend stupides.

C'est nous qui le faisons en choisissant la facilité à chaque prompt.

(je simplifie ici, je te recommande de bloquer ta pause repas pour apprécier le travail de Michaël dans sa totalité)

Cette vidéo a réveillé quelque chose que je ressentais depuis longtemps.

J'ai toujours avancé à tâtons avec l'IA.

Depuis les premiers jours.

- Jamais vraiment convaincu

- Jamais vraiment opposé

- Juste... méfiant

Une appréhension sourde.

Pas de discours doomer du genre « l'IA est le mal absolu et doit être freinée à tout prix »…

Ni d'accélérationnisme enthousiaste du type « déployons tout maintenant, les problèmes se régleront d'eux-mêmes ».

Juste l'impression diffuse de jouer avec quelque chose de dangereux sans savoir exactement où était le piège.

(alors qu'il était sous mes yeux depuis le début)

J'ai alors commencé à faire l'erreur nécessaire que tout solopreneur s'est amusé à faire :

Jouer plus vite et plus fort avec l'IA.

- Déléguer de plus en plus de fonctions

- Gagner du temps partout où on pouvait en gagner

- Tester les limites de ce qu'elle pouvait prendre en charge

Jusqu'au jour où on s'est retrouvé avec une panne chez OpenAI.

De longues heures sans lesquelles je ne pouvais plus utiliser l'IA.

Juste suffisamment de temps pour réaliser avec effroi…

Que je ne pouvais plus fournir la moitié de mon taff.

La p*tain de douche froide.

Le choc n'était pas la perte de compétences en elle-même.

Elle était réversible.

Ça n'était pas très grave.

Le choc venait de la vitesse de cette perte.

On parle pas d'années là.

Quelques semaines à peine pour rendre mon cerveau moins efficace dans la gestion et l'exécution de son art.

Du use it or loose it neuroscientifique dans toute sa splendeur.

Face à ce constat, j'ai pris un virage à 180°.

J'ai développé 2 filtres pour naviguer dans ce champ de mines cognitif sans me lobotomiser.

2 principes simples qui régissent désormais chaque interaction que j'ai avec l'IA.

(évidemment, tout ça peut bouger — rien n'est éternel dans la sphère IA, l'adaptation est la règle)

Filtre 1 : Apprentissage vs. Computation

La première chose que j'ai comprise, c'est que toutes les tâches ne se valent pas.

Certaines gagnent à être difficiles.

D'autres sont juste de la pure perte d'énergie.

Je divise donc mon taff en 2 catégories simples :

Apprentissage Actif — Les tâches où l'effort encode la connaissance dans ton cerveau. Plus c'est dur, plus ça reste. Quand tu synthétises un concept, quand tu relies deux idées distantes, quand tu crées une structure mentale originale, quand tu travailles un raisonnement, tu apprends. Ton cerveau se recâble. Les connexions neuronales se renforcent. L'effort a une valeur d'apprentissage.

Computation Pure — Les tâches qui mobilisent ta puissance de calcul sans créer d'apprentissage. De la mécanique mentale. Analyser une base de 500 notes pour trouver des patterns. Croiser des données. Identifier des opportunités de contenu. C'est utile. Mais ça ne te rend pas plus intelligent. C'est juste du traitement.

Mon Système d'Introspection Avancé est un très bon exemple de Computation Pure.

Le point de bascule est donc là :

Avant chaque délégation, demande-toi si cette tâche te rend plus intelligent en la faisant, ou si c'est juste de la computation.

- Si c'est de l'apprentissage → garde-la (même si c'est plus lent et difficile)

- Si c'est de la computation → délègue sans culpabilité

Ce filtre m'a permis de déléguer intelligemment sans sacrifier mon autonomie cognitive.

Mais il ne suffit pas.

Filtre 2 : Le Filtre de Délégation

Ce filtre est régi par une règle d'or :

Tout ce que tu confies à l'IA, tu l'atrophies.

C'est mécanique. C'est biologique. C'est inévitable.

« La technologie atrophie la partie du cerveau qu'elle amplifie. »

Chaque fonction cognitive que tu délègues est une fonction que ton cerveau considère comme inutile.

Et ce qui est inutile, le cerveau l'élague.

C'est de l'optimisation énergétique.

Pourquoi maintenir un circuit neuronal actif si tu ne l'utilises jamais ?

(encore une fois, le principe use it or loose it)

Le modèle tient en 3 questions :

Quelle fonction cognitive cette tâche sollicite-t-elle ? — Réflexion ? Construction d'arguments ? Créativité ? Analyse ? Recherche de métaphores ? Identifie la capacité mentale en jeu.

Est-ce une compétence essentielle que je veux garder ? — Stratégiquement, est-ce que cette fonction fait partie de mon noyau dur cognitif ? Ou est-ce accessoire ?

Est-ce que j'accepte de perdre cette capacité ? — La vraie question. Parce que si tu délègues, tu vas la perdre. C'est une certitude.

L'IA n'est pas neutre.

Chaque usage est un choix stratégique avec des conséquences à long terme.

La délégation devient addiction si elle n'est pas consciente.

Depuis mon virage à 180°, je ne délègue à l'IA que ce que je suis prêt à perdre.

Le reste, je le garde.

Exemple concret :

Je délègue la recherche de pattern dans une masse de données.

C'est de la computation.

Ça prend 3 minutes à l'IA, ça me prendrait plusieurs minutes (voire heures en fonction du volume de données) et je m'en tamponne l'oreille avec une babouche.

(tu l'attendais celui-là)

Par contre, je ne délègue jamais :

- La construction d'un argument

- La structuration d'une pensée

- L'articulation d'un modèle mental

Parce que c'est là que mon cerveau se renforce.

C'est là que je deviens meilleur.

Je vois l'IA comme un collaborateur qui affine plutôt qu'un exécutant qui remplace.

Ces 2 filtres semblent simples.

Mais si personne ne les applique, c'est bien pour une raison :

Le Coût de la Souveraineté Cognitive

Résister à l'IA a un prix que peu d'humains sont prêts à payer.

Un triple sacrifice.

Sacrifice 1 — Productivité — Tu vas produire moins et plus lentement que ceux qui utilisent massivement l'IA. Pendant qu'ils sortent 3 articles par jour avec GPT-5.2, toi tu en sors 1. Le différentiel est visible.

Sacrifice 2 — Statut Social — Tu vas voir des gens moins compétents que toi obtenir plus de résultats. Plus de likes. Plus de clients. Plus de validation. Parce qu'ils produisent en masse. Parce qu'ils ont compris le jeu de l'IA. Et toi, tu restes là, avec ta lenteur intentionnelle, à regarder des blaireaux se gaver.

Sacrifice 3 — Reconnaissance Immédiate — Le gain de ton approche est invisible à court terme. Garder ton autonomie cognitive dans 5 ans, ça ne se mesure pas aujourd'hui. Mais le coût, lui, est tangible. Moins de contenu. Moins de contrats. Moins de croissance.

Dans une société qui valorise l'ultra-productivisme comme badge d'honneur, choisir la lenteur intentionnelle devient un acte de résistance coûteux.

Voir quelqu'un « réussir plus vite » grâce à l'IA crée une tension cognitive insupportable.

Tu commences à douter.

« Peut-être que je me trompe. Peut-être que je devrais juste lâcher prise. »

Et c'est exactement là que la plupart cèdent.

Parce que le coût immédiat est tangible alors que le gain long terme est abstrait.

Loi de Laborit.

Notre cerveau est câblé pour la gratification immédiate.

Pas pour l'investissement à long terme.

Le truc c'est que si tu penses que le coût de la souveraineté cognitive est trop important…

Attends de voir celui de la Dépendance Cognitive.

Parce que voici ce qui se passe quand personne ne paie ce prix.

La Fracture Cognitive

Une ligne de fracture invisible est en train de se creuser entre 2 types d'humains.

Les Souverains Cognitifs — Ceux qui acceptent de ralentir intentionnellement. Qui gardent leurs capacités de réflexion. Qui amplifient stratégiquement avec l'IA sur des tâches spécifiques. Ils utilisent l'IA comme un outil au service de leur pensée. Pas comme un substitut.

Les Dépendants Cognitifs — Ceux qui cèdent à la facilité immédiate. Qui délèguent toute cognition à l'IA. Qui deviennent incapables de raisonner sans assistance comme un muscle qui s'est atrophié faute d'usage. Ils peuvent encore produire mais ne peuvent plus penser.

Ce qui me terrifie le plus avec cet écart c'est qu'il est quasi-irréversible.

Plus le temps passe, plus les premiers conservent leur autonomie intellectuelle.

Plus les seconds perdent toute capacité à naviguer sans l'IA.

Un muscle mental atrophié pendant des années ne se reconstruit pas facilement.

Si c'était possible, ça prendrait des plombes.

Et la plupart ne le feront jamais parce qu'ils ne réaliseront jamais qu'ils ont perdu quelque chose.

Dans 5 ans, il y aura ceux qui savent encore penser sans assistance.

Et ceux qui ne peuvent plus.

La fracture n'est pas technologique.

Elle est cognitive.

Ce n'est pas « pour ou contre l'IA ».

C'est : « De quel côté de la fracture je veux être ? »

Accepter consciemment le désavantage social à court terme devient un investissement stratégique dans son autonomie future.

Le choix se fait maintenant.

À chaque prompt/délégation.

Pour finir, je tiens à être limpide sur un sujet :

L'IA n'est pas le problème.

C'est un outil comme un autre.

Un couteau peut couper des tomates ou tuer des gens.

Le problème, ce n'est pas le couteau — c'est ce qu'on en fait.

L'IA ne va pas nous rendre stupides.

On va se rendre stupides tout seuls si on choisit systématiquement le chemin le plus court.

Je ne suis pas anti-IA.

Loin de là.

(j'ai 8-9 agents que j'utilise au quotidien pour gérer la TDS)

L'IA est un outil extraordinaire.

Surtout pour la Tribu dont le mantra est « Travailler Moins. Accomplir Plus. Vivre Intensément ».

Elle peut amplifier nos capacités de façon inédite dans l'histoire humaine.

Ce que tu peux accomplir en 4H avec l'IA aurait demandé 40H il y a 5 ans, c'est insane.

Donc le problème n'est pas l'outil.

C'est notre rapport à l'outil.

On a entre les mains quelque chose de puissant.

Mais cette puissance peut aussi bien nous libérer que nous détruire.

La différence tient à notre capacité à choisir consciemment ce qu'on lui confie.

(choix qui restera évidemment subjectif et contextuel — dépendant de nos valeurs et priorités respectives)

Ces 2 filtres ne sont pas des interdictions.

Ce sont des boussoles qui permettent de naviguer dans un monde où l'IA devient omniprésente sans perdre son autonomie.

Sans devenir « inutile à soi-même ».

N'oublie pas que notre activité de solopreneur a aussi pour but de satisfaire un des 4 besoins fondamentaux de l'être humain :

Le besoin intellectuel.

L'expansion cognitive.

La satisfaction dans l'utilisation de notre puissance de frappe à des fins altruistes et existentialistes.

Le coût de la souveraineté cognitive est réel.

Mais c'est, à mon sens, le seul investissement qui compte vraiment.

La pleine possession de ses capacités intellectuelles plutôt que son sacrifice sur l'autel du productivisme.

D'ici 5 ans, les dividendes commenceront à tomber d'un côté de la fracture.

La seule question qui reste…

De quel côté seras-tu ?

__

𝐓𝐮 𝐚𝐬 𝐚𝐢𝐦𝐞́ 𝐜𝐞 𝐩𝐨𝐬𝐭 ? 𝐉'𝐞𝐧 𝐞́𝐜𝐫𝐢𝐬 𝟑/𝐬𝐞𝐦𝐚𝐢𝐧𝐞 𝐝𝐚𝐧𝐬 𝐦𝐚 𝐧𝐞𝐰𝐬𝐥𝐞𝐭𝐭𝐞𝐫.

𝐂𝐥𝐢𝐪𝐮𝐞 𝐢𝐜𝐢 𝐩𝐨𝐮𝐫 𝐥𝐚 𝐫𝐞𝐣𝐨𝐢𝐧𝐝𝐫𝐞 (& 𝐫𝐞𝐜̧𝐨𝐢𝐭 𝐭𝐨𝐧 𝐊𝐢𝐭 𝐝𝐞 𝐏𝐞𝐫𝐟𝐨𝐫𝐦𝐚𝐧𝐜𝐞 𝐨𝐟𝐟𝐞𝐫𝐭)